미국의 한 고위 외교관이 불법 행위에 의해 AI 기반으로 사칭되는 사건이 일어났습니다. 이는 현대 사회에서 AI가 악용될 수 있는 위험성을 보여주는 대표적인 사례로 주목받고 있습니다.

AI 기술의 발전은 기존의 보안 체계를 무력화하고, 새로운 형태의 사이버 범죄를 탄생시키고 있습니다. 사기꾼은 AI를 활용해 외교관의 목소리와 화법을 재현하고, 이를 통해 기밀 정보에 접근하거나 외교적 혼란을 초래할 수 있습니다. 이 사건은 AI의 발전과 더불어 디지털 보안의 강화 필요성을 다시 한 번 환기시켰습니다.

이번 사건에서 사용된 AI 기술은 특히 딥러닝을 활용한 음성 합성 기술로, 사칭 대상의 목소리를 거의 완벽하게 모방할 수 있는 수준에 도달해 있습니다. 이것은 AI를 활용한 범죄 행위가 얼마나 교묘하고 마치 실제처럼 느껴질 수 있는지를 보여줍니다. 이러한 기술은 외교 분야뿐만 아니라, 기업의 고위직, 유명인사 등 여러 분야에 걸쳐 악용될 가능성이 있습니다.

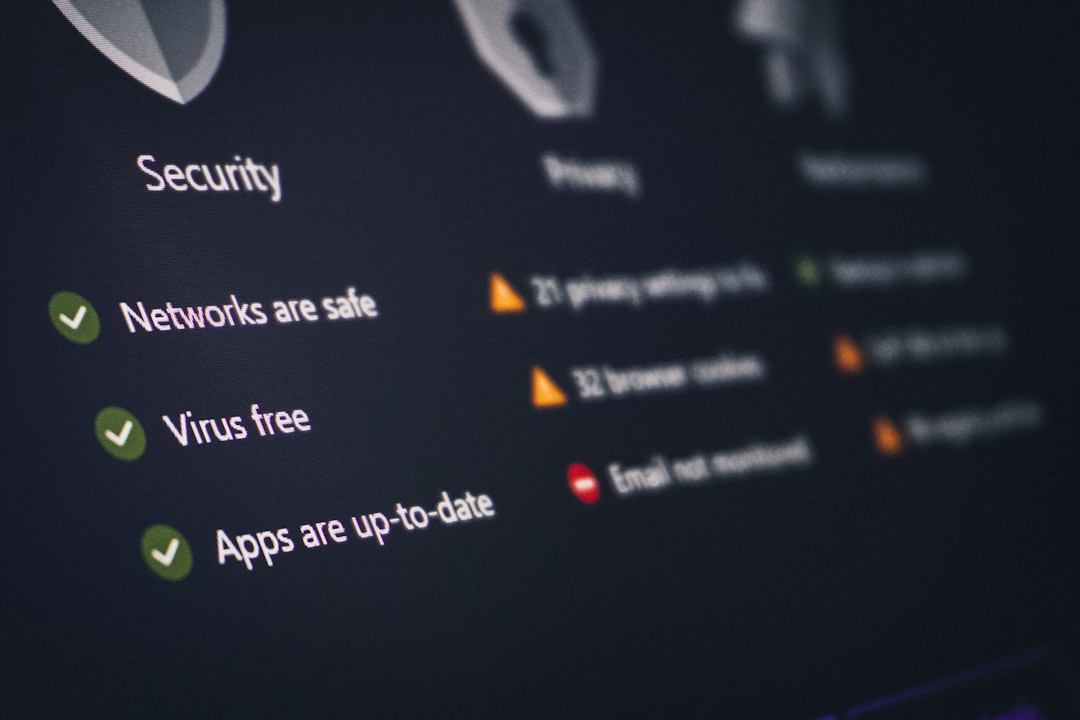

AI 사기 사칭의 주요 문제는 믿을 수 있는 검증 수단이 부족하다는 점입니다. 음성 인식에 기반한 인증 시스템은 AI에 의해 위험에 처할 수 있으며, 이를 방지하기 위한 대체 기술의 필요성이 대두되고 있습니다. 최근 몇 년간 AI에 기반한 사기 수법이 증가하고 있으며, 이는 이제 어떤 정보 처리 분야에서든 중요한 위협이 되고 있습니다.

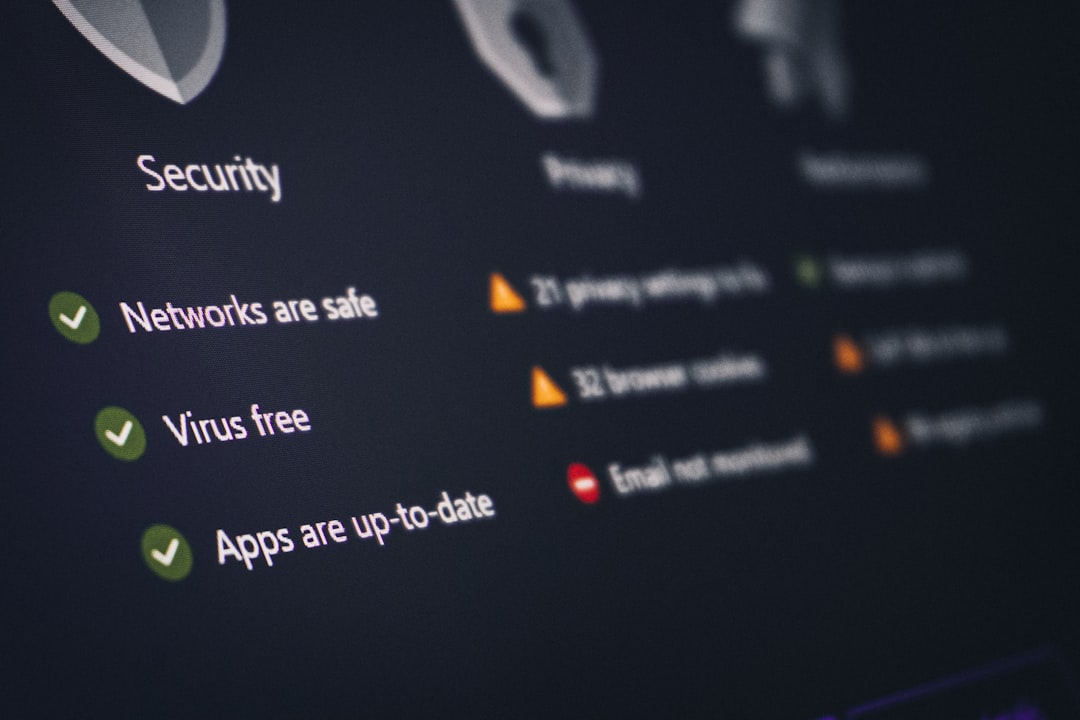

사건이 벌어진 후, 여러 디지털 보안 전문가들은 AI 기술의 발전을 거리감 있게 받아들이며, 대치할 수 있는 새로운 보안 체계를 개발하기 위한 노력이 필요하다고 주장하고 있습니다. 강화된 생체인식 기술, 물리적 보안 요소의 결합, AI 탐지 기술 등의 발전이 그 예시입니다.

이번 사건은 불행하게도 향후 일어날 유사한 사기에 대한 경각심을 높였고, 정부와 기업은 AI 기술 진보의 두 얼굴을 인식할 필요가 있습니다. 기술 발전이 가져올 수 있는 이익과 위험을 경계하면서, AI 기술을 조절하고 책임 있게 사용하는 방안을 마련하는 일이 필수적입니다.

결론적으로, 해당 사건은 AI 기술이 가져다주는 기회를 충분히 활용하되, 그에 따르는 위험성을 어떻게 감수해야 할 것인가에 대한 중요한 질문을 던집니다. 글로벌 사회는 이제 AI의 면면을 정확히 인지하고, 적절한 대응 방안을 마련해야 하는 중대한 순간에 직면해 있습니다.

Cyber Security

Top US diplomat impersonated with AI by unknown actor

Leave a Reply